近日,银河集团186net李远宁教授与合作团队以“Dissecting neural computations in the human auditory pathway using deep neural networks for speech”《运用深度神经网络语音模型解析人脑听觉通路的神经计算》为题在 Nature Neuroscience 上在线发表最新研究成果。

人类依赖大脑的听觉通路实现高效精准的语音信号处理,能够轻松实现每分钟300个汉字或者150个英文单词以上的自然语音识别。如何建模大脑的听觉和语言环路并解析自然语音感知的神经机制是长久以来认知和计算神经科学关注的重要问题。而在人工智能领域,计算机科学家花费了数十年才实现了较为接近人类水平的自动语音识别模型。这类纯工程的 AI 模型抛弃了早期基于语言学理论的模型框架,完全采用数据驱动的端到端大规模预训练深度神经网络。

这些人工智能模型与大脑听觉回路能够接收相同的语音输入,并执行相似的认知功能,两者之间是否存在计算和表征上的相似性呢?这是该项研究聚焦的关键问题所在。针对这一问题,本研究在大规模自然语音上使用不同架构与预训练方式训练了多种不同的深度神经网络模型,通过高密度颅内脑电、以及单神经元仿真模型等多种技术方法,记录贯穿整个听觉通路从耳蜗到皮层的神经活动信号,在中英文跨语言对照实验范式下,深入分析了 AI 语音模型与人脑听觉通路在计算与表征上的相似性。

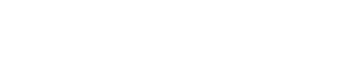

基本研究模型:基于预训练深度语音网络特征,构建神经编码模型,预测听觉通路对应的语音神经响应。

研究结果表明,基于自监督预训练 AI 语音模型所提取的语音特征,可以较为准确地预测听觉通路的神经活动,证明了两者之间的高度相关性,并且相较传统的基于神经语言学的特征编码预测模型相似度提升至少20%以上。而进一步的计算模型分析表明,AI 模型所抽取的语音特征与大脑神经活动的相似性可以通过 Transformer 架构中的自注意力计算模式进行解释,该机制可以有效提取与大脑中对语音上下文理解所相似的关键序列结构,从而实现与大脑听觉通路相似的语音表征。

从神经科学的角度,这项研究与近期发表的多项相关研究一道,提出了基于大规模自监督模型建立语言相关的认知功能计算模型的新思路,揭示了自监督语音模型与大脑听觉通路的计算与表征的相似性,同时也挑战了基于逐级皮质区域的分层前馈处理的听觉腹流概念。从人工智能的角度,这项研究也为打开深度神经网络、特别是自注意力模型 Transformer 的“黑箱”提供了新的生物学视角。

生银河集团186net助理教授李远宁为本文第一作者,加州大学旧金山分校神经外科 Edward Chang 教授为本文通讯作者,复旦大学附属华山医院吴劲松教授、路俊锋教授,生银河集团186net硕士研究生陈佩利,加州大学伯克利分校、Meta AI 以及罗彻斯特大学的研究者参与了此项研究。

目前,李远宁课题组与复旦大学附属华山医院神经外科团队围绕语言的神经机制以及汉语脑机接口展开合作研究。今年,合作团队另外两项关于汉语神经机制以及汉语脑机接口的研究成果分别在 Nature Communications 及 Science Advances 上发表。

论文链接:

https://doi.org/10.1038/s41593-023-01468-4

Li Y, Anumanchipalli GK, Mohamed A, Chen P, Carney LH, Lu J, Wu J, Chang EF. Dissecting neural computations in the human auditory pathway using deep neural networks for speech. Nat Neurosci. 2023 Oct 30. doi: 10.1038/s41593-023-01468-4. Epubahead of print. PMID: 37904043.

排版、编辑 时茗钰

吴天祎